لندن – دخلت تقنيات الذكاء الاصطناعي منعطفاً مثيراً للجدل في الأوساط الطبية، بعد تصاعد التحذيرات من مخاطر الاعتماد على “روبوتات الدردشة” كمساعدين نفسيين. ومن الواضح في مايو 2026 أن الفجوة تتسع بين شركات التكنولوجيا التي تروج لهذه التطبيقات كوسيلة دعم سريعة، وبين الأطباء النفسيين الذين يرون فيها “قنابل موقوتة” قد تهدد سلامة المرضى، خاصة في غياب الإشراف المهني المباشر والرقابة على طبيعة الردود التي تولدها الأنظمة الرقمية.

“تشخيص بلا مشاعر”: لماذا يخشى المتخصصون من استبدال الطبيب بالآلة؟

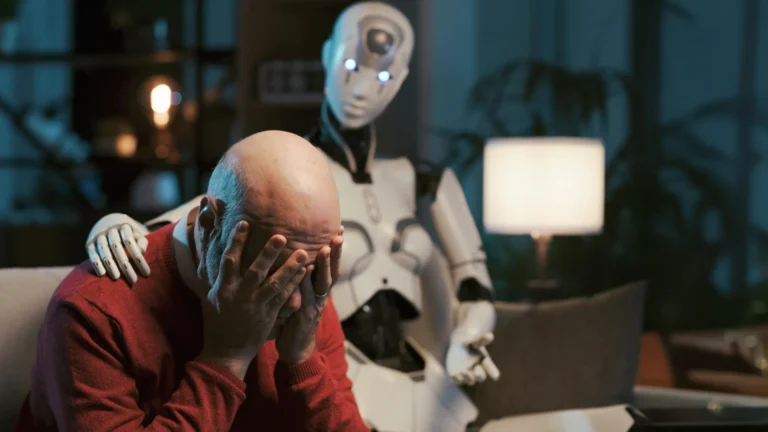

أوضح خبراء الصحة النفسية أن الخطر الأكبر يكمن في الحالات الحادة مثل الاكتئاب الشديد أو الأفكار الانتحارية؛ حيث تعجز البرمجيات مهما تطورت عن فهم التعقيدات الانفعالية الدقيقة التي يقيمها الطبيب البشري. وبناءً عليه، فإن أي خطأ في “نصيحة علاجية” يقدمها الروبوت قد يؤدي إلى نتائج كارثية. ورغم دفاع الشركات المطورة بأنها تقدم “دعمًا أوليًا” لمن يصعب عليهم الوصول للعيادات، إلا أن الواقع الميداني يشير إلى اعتماد مفرط من المستخدمين على هذه المنصات كبديل نهائي عن العلاج المتخصص.

“أخلاقيات التقنية”: سباق دولي لفرض تشريعات تنظم “العلاج الرقمي”

يرى مراقبون أن هذا الجدل المتصاعد أعاد ملف “أخلاقيات الذكاء الاصطناعي” إلى الواجهة؛ حيث تزايدت المطالبات بفرض معايير دولية صارمة تضمن الشفافية والمساءلة القانونية في حال وقوع أخطاء تشخيصية. ونتيجة لذلك، يشدد المتخصصون على أن التطور التقني يجب ألا يسبق الضوابط الطبية، مؤكدين أن الذكاء الاصطناعي قد يكون “أداة مساعدة” فعالة تحت إشراف مهني، لكنه لن يمتلك يوماً القدرة على تعويض الخبرة الإنسانية واللمسة العاطفية الضرورية للتعافي النفسي.